研究内容の紹介

李研では、音声言語処理・対話を中心として、理論と実践の両輪を重視した幅広いトピックについて研究する場を提供しています。以下は大まかな研究分野です。

- 音声認識・音声合成

- 音声対話システム

- 自然言語処理

- CGエージェントインタラクション

- アバターコミュニケーション支援

近年、ニューラルネットワーク、特に大規模言語モデル(LLM)の登場によりこれらの研究分野は大きく様相が変わりつつあります。以下、それぞれの研究内容について概要と実際の研究テーマ例を紹介します。

音声認識・音声合成

人間の音声をテキストに書き下したり、話者や場面といった時間ラベルを付与する自動音声認識処理は、音声メディア処理の基礎となる技術です。信号処理から言語処理、発話理解までさまざまな情報処理技術を統合して作られています。李研では長年、統計モデルおよび機械学習に基づく音声認識に関する研究を重ねています。オープンソース音声認識エンジン Julius は当研究室PIの李が1996年に開発して以来30年近くの歴史を持ち、国内外で広く利用されてきました。

近年は音声合成に関する研究も取り扱っています。LLMベースの音声合成など最新の技術を取り入れながら、音声認識と音声合成を統合的に捉えた研究を推進しています。

- 音声合成によるデータ生成に基づく高精度音声認識

- Speaker Diarization (who spoke when) とその応用

- Expressive 音声合成(speech-laugh など)

- LLM ベースの音声合成

最近の関連発表

- 上乃 聖,李 晃伸「LLM-based 音声合成における連続性を考慮したビームサーチ」日本音響学会第155回(2026年春季), 1-5-3

- 山川 優綺,上乃 聖,李 晃伸「大規模モデルを用いた演じ分けに着目した落語音声合成」日本音響学会第155回(2026年春季), 1-Q-31

- 市川 奎吾,上乃 聖,李 晃伸「話者遷移確率に基づく話者ダイアライゼーションのためのデータ生成」日本音響学会第153回(2025年春季), 3-P-2

音声対話システム

機械に音声で話しかけ、音声で返事を受け取る音声対話システムに関する研究を行っています。人間のような知的な対話を実現するには、入口・出口となる音声認識・音声合成技術に加えて、会話の状況の理解、相手の特性の把握、会話のゴールに向けた戦略立案、エラーの検知など、さまざまな知的処理を統合する必要があります。従来は、これらのモジュールごとの研究が多面的に行われていましたが、近年はニューラルネットワークでこれらをまとめて一気に学習する end-to-end なアプローチが研究され、特に大規模言語モデル(LLM)の登場によって、これらの精度が飛躍的に向上しています。また、カメラや各種センサーによる入力から状況を判断したり、身振り手振りや感情を交えた応答を行うマルチモーダル対話システムは、場に即した気の利いた対話を行うのに有効です。

本研究室では、長年の機械音声対話システムの実践に関する知見の上に立ち、主に企業や研究プロジェクトと連携しながら、音声対話システムに関する研究を行っています。マルチモーダル対話プラットフォーム Remdis を中心に、LLMを活用した次世代の対話システム構築に取り組んでいます。

- LLMに基づく車室内音声情報案内システム(自動車企業とともに)

- AI模擬患者+医療面談自動評価(藤田医科大とともに)

- 情報聞きだしエージェントを用いた遠隔コミュニケーション支援

- メディアコンテンツとしての音声対話システム

最近の関連発表

- 金子 優,上乃 聖,李 晃伸「両価性の気づきの促進を重視する動機づけ面接システム」NLP2026, P5-20

- 𠮷田 拓実,上乃 聖,李 晃伸「医療面接教育のための仮想模擬患者を用いた没入型音声対話システム」HAIシンポジウム2025, P1-8

自然言語処理

テキストを理解・処理する自然言語処理は、データからの統計量に基づいてことばを駆動する統計言語モデルが主流です。近年は、データ量および計算能力の飛躍的な増大を背景に、N-gram のようなシンプルなモデルからニューラルネットワーク、そして大規模言語モデルへと劇的な進展を遂げています。当研究室では急速に発達する自然言語処理分野の中で、特に人対人の対話に関する事柄にフォーカスした研究を行っています。

- オンライン動機付け面接システム

- ユーザの思考の明確化・言語化を目標とする対話

- ナラティブ言語処理:人物関係抽出・あらすじ生成

最近の関連発表

- 鈴木 香保,上乃 聖,李 晃伸「発散・深掘り対話戦略に基づくLLM対話システムによる悩みの内省支援」NLP2026, P5-17

- 箕成 侑音,上乃 聖,李 晃伸「LLM ベースのマルチエージェントによる TRPG ゲームマスターシステムの実現」NLP2025, P10-17

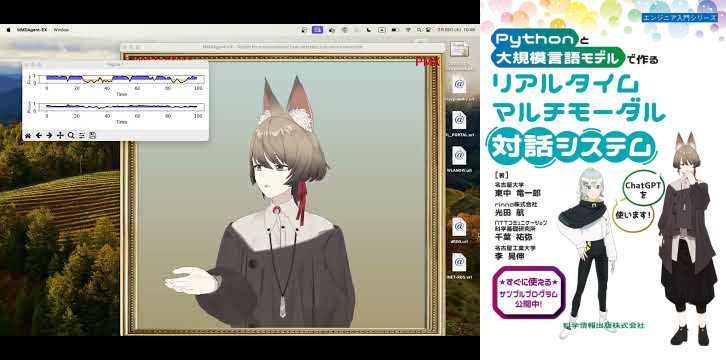

CGエージェントインタラクション

自然な会話が行える機械対話システムが実現したとき、その見た目は人型 (Humanoid) であることが自然です。本研究室では「人型UIとしてのCGエージェント」に焦点をあてて、全身を持ち身体コミュニケーションが可能な CG キャラクター(CGエージェント、あるいは ECA; Embodied Conversational Agent)を用いた対話システムおよびインタフェースの研究を行っています。

人間とCGエージェントはまだ自然なコミュニケーションがうまく取れません。この解決には、実践によるデータ収集と分析が重要です。当研究室は単体で音声認識、音声合成、音声対話、および独自のエージェント対話ソフトウェアによるCGエージェントインタラクションのオリジナルの技術を有しており、信号処理からCGアバターデザインまでトータルで取り組んでいます。

- CGアバターを用いた身体コミュニケーション支援

- ふるまい・身体動作の自動生成

- CGエージェントのデザイン論

- CGエージェントの設計・制作・公開

特に CG エージェントとの対話における違和感を解消し、特別に意識しなくても人間と同じように気軽に会話できるCGエージェントに関する研究を行っています。

- 対話性認知:会話できる相手であるという認知

- CG特有の会話様式

- 対話のためのアフォーダンス

- 自己投影アバターを用いた空間引き込み

- 仮想ソーシャルタッチ

最近の関連発表

- 稲葉 響,上乃 聖,李 晃伸「音声対話エージェントにおけるCGらしさと人間らしさを統合したふるまい表現」HAIシンポジウム2026, P1-22

- 山田 航暉,上乃 聖,李 晃伸「CGエージェントを用いた対話システムにおける疑似ソーシャルタッチの効果」HAIシンポジウム2025, P2-45

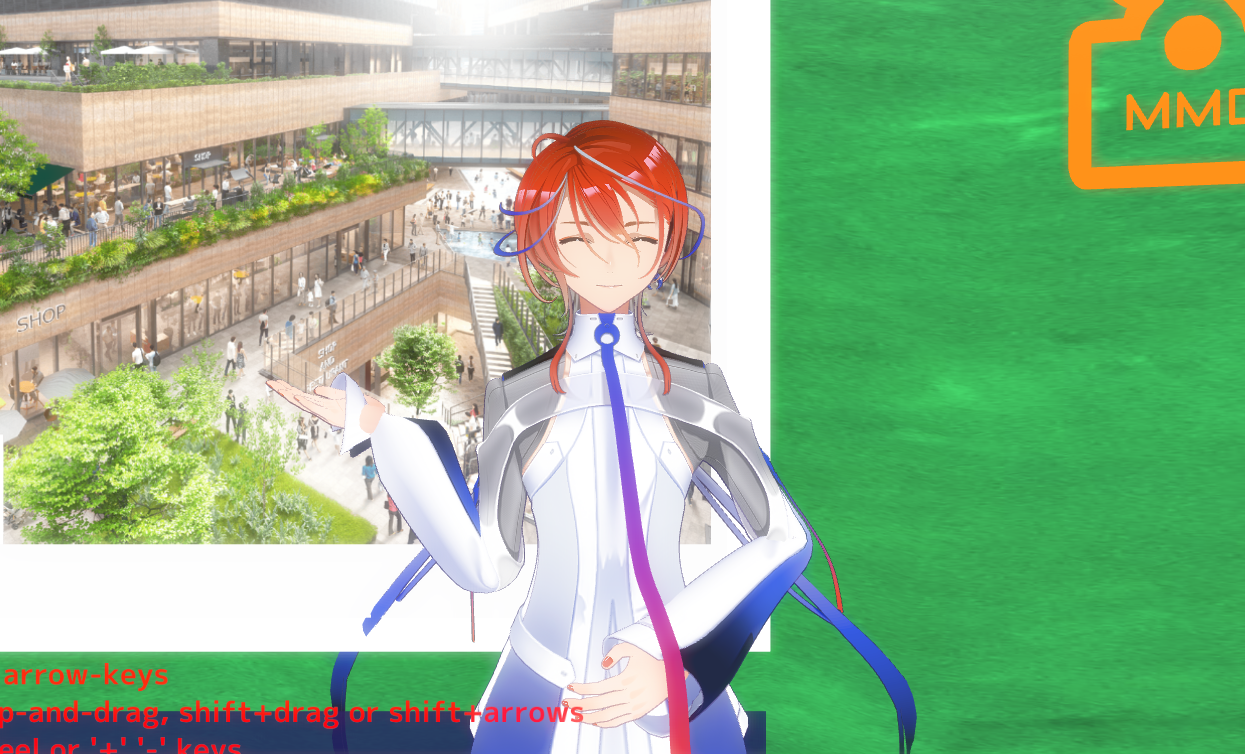

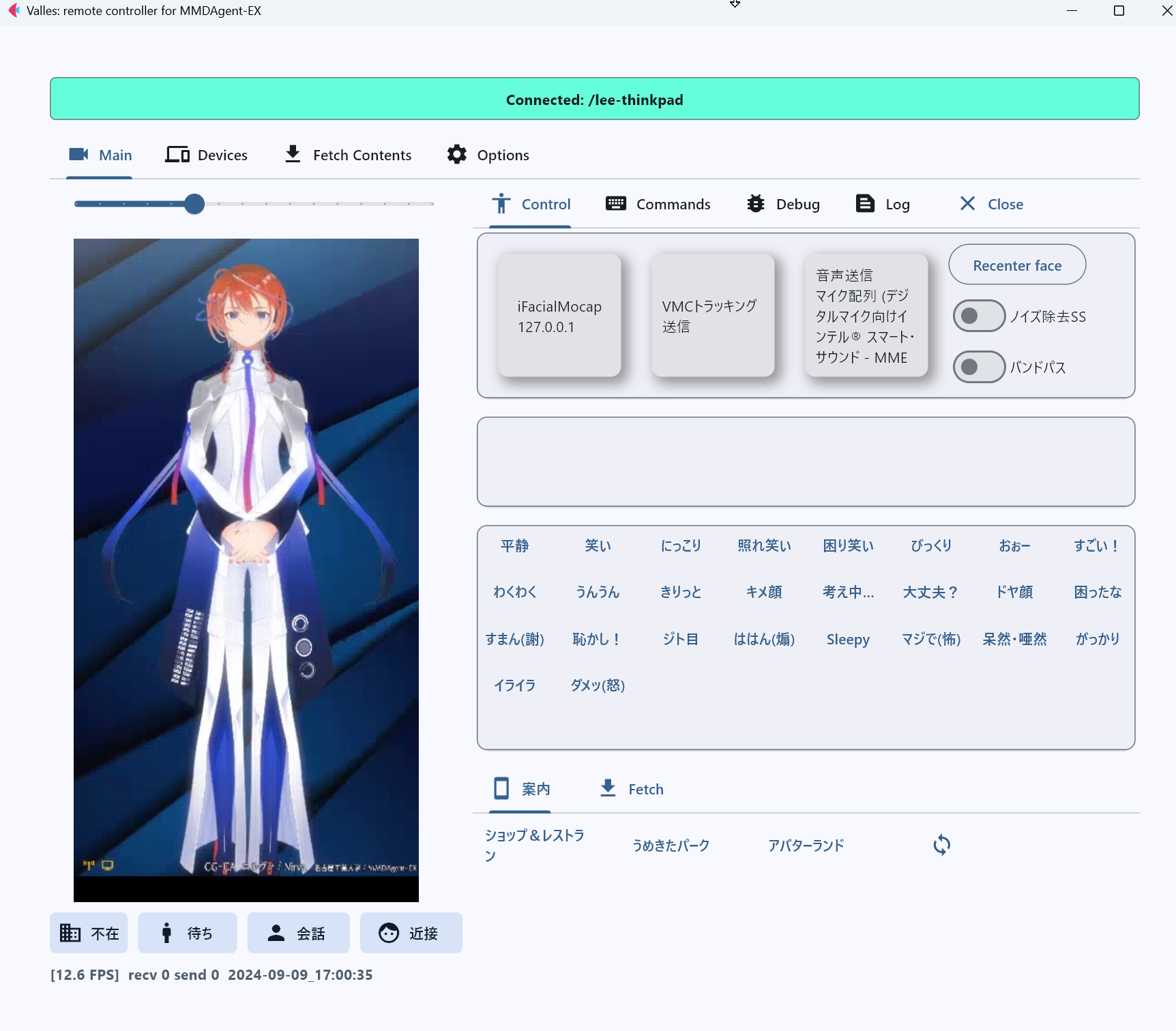

アバターコミュニケーション支援

ロボットやCGキャラクターに人が入り込んで遠隔操作で会話や活動を行う「アバター」の研究が従来より行われています。特に近年は、VTuber のように配信者がCGアバターを使って会話する様子が主にネット文化として見られるようになりました。CGアバターを用いた会話は、時間・場所の制約の緩和、プライバシー保護、外に出にくい事情を抱える人の社会参画支援、多様な生き方の支援など、様々な社会応用が期待されています。

当研究室では、CGエージェント対話システムの知見を活かして、人間がCGキャラクターを操作して人と人が会話するためのCGアバターコミュニケーション支援の研究を行っています。CGアバターを用いた会話はまだ違和感や制限が大きく、一般的な手段として普及していません。我々は、ムーンショット研究開発事業「誰もが自在に活躍できるアバター共生社会の実現 プロジェクトのもと、いつでも、どこでも、誰でも使えるアバターシステムの実現と社会普及を目指した研究を行っています。

- CGアバター操演統合システムの研究開発(avatar1000システム)

- CGキャラクターを介する会話の様式や要件の定義

- 音声からのリアルタイムふるまい生成:Speech2Motion

- アバター操演コーパスの収集

最近の関連発表

- 鈴木 颯真,上乃 聖,李 晃伸「アバター会話支援のための音声からのリアルタイム会話モーション生成の検討」HAIシンポジウム2025, P1-15